記得OpenAi官方也曾說過,GPT是最強的語言模型,始終強調可以理解文本、上下文對話的內容。

一共150筆SEC題目與答案(截圖來源:PatronusAI/financebench)

New Bing(使用GPT-4)產生的數字幻覺

Google Bard(使用Gemini Pro模型)產生的的數字幻覺

至於文件摘要的部分,New Bing也只能摘要第一頁面的部份,無法做整篇的文本內容章節摘要。(在相同的條件比較下,使用Gemini Pro模型的Google Bard還顯得比較有優勢,因為使用ChatGPT-4模型的New Bing必須仰賴搜尋引擎插件下,才能順利完整寫出內容摘要。)

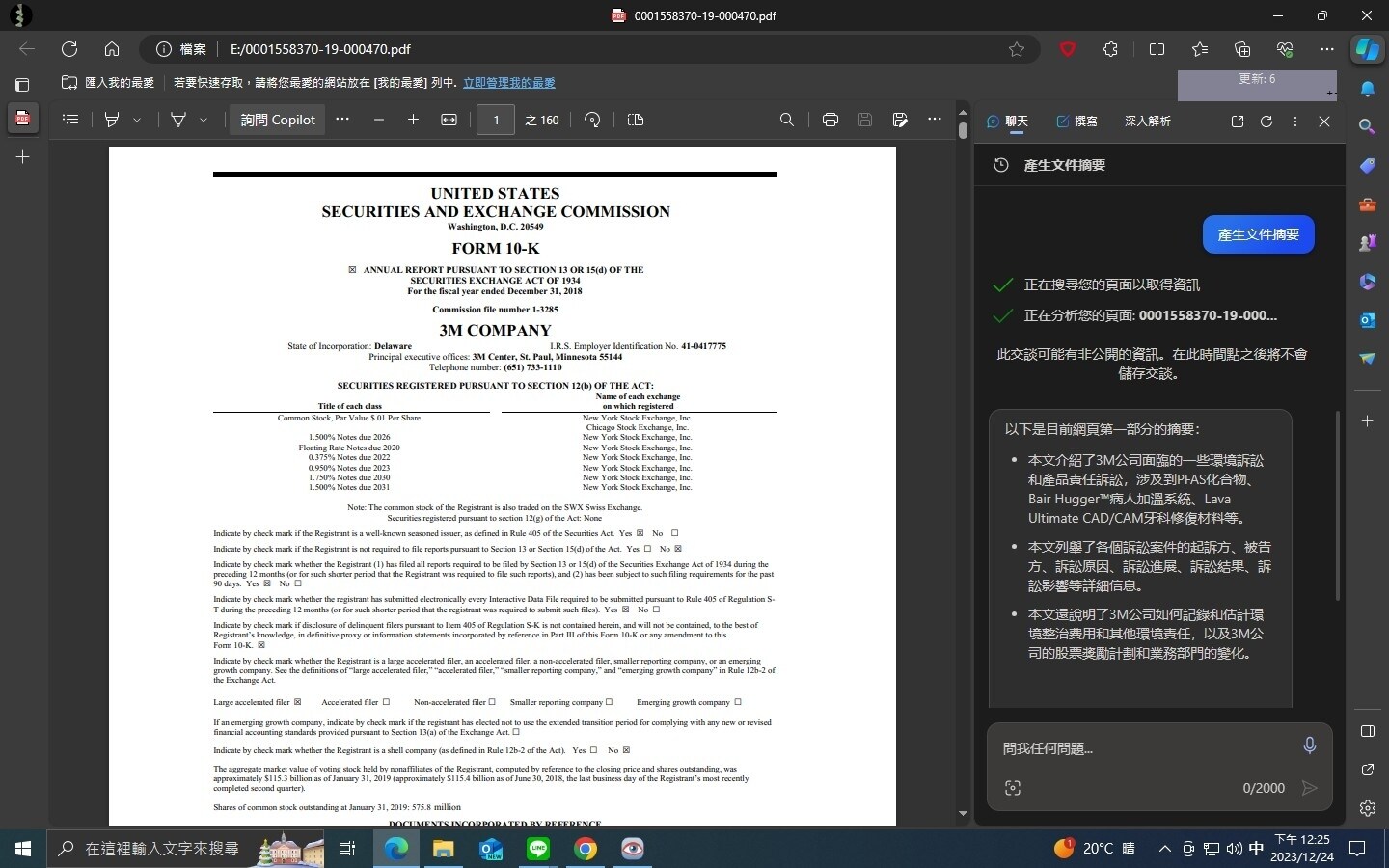

New Bing文件摘要(搭載GPT-4模型,無支援搜尋引擎插件)

Google Bard(使用Gemini Pro模型)生成文件摘要(無支援搜尋引擎插件)

New Bing文件摘要(搭載GPT-4模型,無支援搜尋引擎插件)

Google Bard(使用Gemini Pro模型)生成文件摘要(無支援搜尋引擎插件)

Google Bard(使用Gemini Pro模型)生成文件總結(無支援搜尋引擎插件)

所以,合理反推,ChatGPT-4若將搜尋引擎的功能插件給手動關掉,再進行SEC文件內容提問,其準確度表現也會隨之降級,幻覺程度大量提升。

延伸閱讀:

ChatGPT Plus將可搜尋網際網路,但僅使用微軟Bing

所謂的最強語言模型、GPT-4感覺比較好用,認真講破了,其實就是建立在搜尋引擎的插件上而已,只要語言模型無法支援搜尋引擎去找出答案,論結果上也就強不起來。

其中最容易分辨的方式就是,直接問GPT-4、Bing該問題的答案是在該文件內容的第幾頁?這樣就能知道ai模型是不是有使用搜尋引擎插件了,若無法回答,就表示它只能依賴搜尋引擎的內容摘要來作答。

因此,從這樁實驗結果來看,降低生成式AI幻覺的具體解決方案是什麼?請支援搜尋引擎插件為當前正解。

相關閱讀:

[動眼看] Gemini Pro模型實測:圖片推理分析 + 生成YT影片摘要 + 文件讀取

所謂的最強語言模型、GPT-4感覺比較好用,認真講破了,其實就是建立在搜尋引擎的插件上而已,只要語言模型無法支援搜尋引擎去找出答案,論結果上也就強不起來。

其中最容易分辨的方式就是,直接問GPT-4、Bing該問題的答案是在該文件內容的第幾頁?這樣就能知道ai模型是不是有使用搜尋引擎插件了,若無法回答,就表示它只能依賴搜尋引擎的內容摘要來作答。

因此,從這樁實驗結果來看,降低生成式AI幻覺的具體解決方案是什麼?請支援搜尋引擎插件為當前正解。

相關閱讀:

[動眼看] Gemini Pro模型實測:圖片推理分析 + 生成YT影片摘要 + 文件讀取